今週は、、、

AIの空間認識能力がどんどん向上しています。

ロボットxAI つまりフィジカルAIが爆発的に進化しそうです。

Claude がデザインサービスを立ち上げました。

Figma mcp との連携が強化されていると同時に、

Claude だけでできちゃうことが、どんどん増えそうです。

AI = SaaSキラーの側面を感じます。

Google.orgとジョンソン・エンド・ジョンソン財団、米国農村部の医療従事者向けAIトレーニングに1,000万ドルの取り組みを開始

日付: 2026/04/14

カテゴリ: Google.org, Health

ソース: Google.org and the Johnson & Johnson Foundation are launching a $10 million initiative to train rural U.S. healthcare workers in AI.

AIの影響に関する新たな研究を支援

Digital Futures Fundの拡充

Google.orgは、AIの可能性と影響を研究する独立系シンクタンクや学術機関を支援するため、総額1,500万ドルの新規助成を発表した。2023年に開始した「Digital Futures Project」の延長として、これまでの累計支援額は世界全体で3,500万ドル超に達する。

研究の3つの柱

新コホートの研究者たちは、以下の3つの重点分野に取り組む。

- 労働と経済 — AIが労働市場・製造業・医療分野に与える影響と、雇用機会を最大化するための政策環境の検討

- イノベーションとインフラ — AIを支えるインフラ・エネルギー需要の把握と、国家競争力への貢献

- セキュリティとガバナンス — 責任あるイノベーションの枠組み構築と、重要機関・企業のセキュリティ強化におけるAIの活用

日付: 2026/04/14

カテゴリ: Google.org

ソース: Supporting new research on the impacts of AI

AI for the Economyフォーラムで人々をつなぐ

日付: 2026/04/14

カテゴリ: Google.org, Creating opportunity, AI

ソース: Bringing people together at AI for the Economy Forum

Googleの地元��で湿地再生と炭素除去科学を推進

日付: 2026/04/14

カテゴリ: Sustainability

ソース: We’re advancing wetland restoration and carbon removal science in Google’s backyard.

世界量子デーに寄せられたトレンドの質問に回答

量子コンピュータとは何か

量子力学の発見は、自然界の理解を根本から変えました。1981年、物理学者リチャード・ファインマンは「自然は量子的であるため、それを真に理解するには量子原理で動くコンピュータが必要だ」と述べました。Google Quantum AIはこの考えに基づき、現在の古典的コンピュータでは解けない複雑な問題を解決するための量子コンピュータ開発に取り組んでいます。

量子ビット(qubit)とブロッホ球

2026年の世界量子デーを記念して、GoogleはロゴにBloch Sphere(ブロッホ球)を取り入れたDoodleを公開しました。ブロッホ球は、量子ビット(qubit)の状態を幾何学的に表現したものです。古典的なビットが0か1の二値しか取れないのに対し、量子ビットはその両方の重ね合わせ状態を取ることができ、はるかに大きな計算空間を実現します。

現在の課題:デコヒーレンス

量子コンピュータの大きな課題は、量子ビットの繊細な状態を維持することです。環境との相互作用により「デコヒーレンス」が起き、量子情報がノイズとして失われてしまいます。現在のGoogle Quantum AIの研究は、意��味のある計算を行うのに十分な時間、この情報を保護できるシステムの構築に集中しています。

量子コンピュータの将来的な可能性

大規模かつエラー訂正された量子コンピュータが実現すれば、より持続可能な材料の発見や創薬の加速など、古典的コンピュータでは不可能な現実世界の問題解決に貢献できると期待されています。Google Quantum AIは、実験的な物理学から信頼性の高い安定したシステムへの長期的な移行を目指しています。

日付: 2026/04/14

カテゴリ: Quantum computing

ソース: Answering your trending questions on World Quantum Day

Gemini Robotics ER-1.6、ロボットが現実世界のタスクをこなすための推論能力を強化

Googleは2026年4月15日、ロボット向け推論特化モデル「Gemini Robotics-ER 1.6」を発表した。本モデルは、ロボットが物理的な環境をより正確に理解できるよう設計されたアップグレード版である。

主な強化点

- 空間論理・マルチビュー理解の向上:ロボットが周囲の環境を前例のない精度で把握できるようになった

- 重要機能の強化:視覚・空間理解、タスク計画、成功検知などロボティクスに不可欠な能力が向上

- 計器読み取り機能(新機能):Boston Dynamicsとの協力により発見された新機能で、複雑なゲージやサイトグラスの読み取りが可能になった

日付: 2026/04/15

カテゴリ: Google DeepMind

ソース: Gemini Robotics ER-1.6 enhances reasoning to help robots navigate real-world tasks.

デスクトップ版Googleアプリが世界中のWindowsユーザーに提供開始

調べごとや相談ごとの際に、

「とりあえずブラウザ」から「とりあえずAIアプリ」に変わりつつあります。

とりあえずチャッピー、とりあえず Claude という流れです。

これは UX の問題であり、機能の優劣の問題ではないわけです。

この点で Google は一歩遅れていたわけです。

ですが、別に、

Google は、本気でアプリを出そうと思えばすぐに出せますよね。

そりゃそうだ。

Googleは、Windows向けデスクトップアプリの強化版を英語圏のユーザーを対象に全世界へ正式公開した。Google検索の機能をデスクトップから直接利用できるようになり、AIモードも搭載されている。

AIモード搭載の検索機能

AIモード��が組み込まれており、気になることを何でも質問すると、AIによる回答とウェブリンクが表示される。

キーボードショートカットで即座にアクセス

Alt + Space のショートカットキーで検索ボックスを瞬時に呼び出せる。ウェブ上の情報だけでなく、PC内のファイル・インストール済みアプリ・Google Driveのファイルも横断的に検索可能。

画面共有でフローを維持

作業中のドキュメントやブラウザを離れることなく、特定のウィンドウまたは画面全体を共有しながら質問を続けられる。

Lensで画面上のものを検索

Google Lensを使って画面上の任意の部分を選択して検索できる。画像やテキストの翻訳、宿題の解決など幅広い用途に対応している。

日付: 2026/04/15

カテゴリ: Search

ソース: The Google app for desktop is now available for Windows users around the world.

お気に入りのAIプロンプトをChromeのワンクリックツールに変換

Skills in Chromeとは

ChromeのAI機能(Gemini in Chrome)で役立つプロンプトを保存・再利用できる新機能「Skills in Chrome」が登場しました。これまでは同じAIタスクを繰り返すたびに同じプロンプトを入力し直す必要がありましたが、この機能によりワンクリックで実行できるようになります。

自分だけのワンクリックワークフローを作成

チャット�履歴から気に入ったプロンプトを「Skill」として保存できます。次回使用時は、/(スラッシュ)を入力するか+ボタンをクリックするだけで、閲覧中のページや選択した複数のタブに対してSkillを実行できます。保存済みのSkillはいつでも編集・新規作成が可能です。

日付: 2026/04/15

カテゴリ: Chrome, AI

ソース: Turn your best AI prompts into one-click tools in Chrome

動的検索広告をAI Maxにアップグレード

日付: 2026/04/15

カテゴリ: Google Ads

ソース: We’re upgrading Dynamic Search Ads to AI Max

Gemini APIの前払いで支出をより細かく管理

日付: 2026/04/15

カテゴリ: Developer tools

ソース: Prepay for the Gemini API to get more control over your spend

Gemini 3.1 Flash TTS:次世代の表現力豊かなAI音声

日付: 2026/04/16

カテゴリ: Gemini models, AI

ソース: Gemini 3.1 Flash TTS: the next generation of expressive AI speech

GeminiアプリがMacに登場

日付: 2026/04/16

カテゴリ: Gemini App

ソース: The Gemini app is now on Mac

ラテンアメリカ各国政府と3つの新たなAIイニシアチブで連携

日付: 2026/04/16

カテゴリ: Google in Latin America

ソース: Partnering with Latin American governments on 3 new AI initiatives

マップ上のビジネスを保護する新たな取り組み

偽の1つ星レビューを削除する代わりに金銭を要求するような詐欺パターンをシステムが検知し、不審な投稿を公開前にブロックする。スパムレビューの急増が検知された場合は、偽コンテンツの削除・新規レビューの一時停止・ビジネスオーナーへの通知・消費者向けバナー表示を行う。今後数週間でグローバル展開予定。

日付: 2026/04/16

カテゴリ: Maps

ソース: New ways we’re protecting businesses on Maps

Grow with Googleのイベントでフォーチュン500企業リーダーと職場のAIを議論

日付: 2026/04/17

カテゴリ: Grow with Google

ソース: Grow with Google’s event discussed AI in the workplace with Fortune 500 company leaders.

Geminiが有害な広告をユーザーの目に触れる前にブロック

日付: 2026/04/17

カテゴリ: Google Ads

ソース: Gemini is stopping harmful ads before people ever see them

Nestサーモスタット、2011年以降で推定140億ドル・2,000億kWhのエネルギーを節約

日付: 2026/04/17

カテゴリ: Google Nest

ソース: Nest thermostats have saved users an estimated $14 billion and 200 billion kWh of energy since 2011.

Geminiアプリでパーソナライズ画像を作成する新しい方法

同一のプロンプトであっても、

人によって生成物が異なってくる。

Google 検索結果が、ひとによって異なるように、画像生成も異なってくる。

個性に合わせた画像になる。

AI の方向性を感じます。

GeminiアプリのPersonal Intelligence機能が強化され、ユーザーの興味・好みを反映した画像生成が可能になった。新モデル「Nano Banana 2」とGoogle Photosを連携させることで、長い説明文や参照写真のアップロードなしに、シンプルなプロンプトだけでパーソナルな画像を生成できる。

日付: 2026/04/17

カテゴリ: Gemini App, Google One, Photos, AI

ソース: New ways to create personalized images in the Gemini app

投票受付中:次のDoodle for Googleの優勝作品を選ぼう

日付: 2026/04/17

カテゴリ: Doodles

ソース: Voting is live: Help choose the next Doodle for Google winner

ChromeのAIモードでウェブを探索する新しい方法

日付: 2026/04/17

カテゴリ: Search, AI, Chrome

ソース: A new way to explore the web with AI Mode in Chrome

この夏、Googleを活用してよりスマートに旅する7つの方法

日付: 2026/04/17

カテゴリ: Search, Maps, Translate, AI

ソース: 7 ways to travel smarter this summer, with help from Google

今年の夏のトレンド旅行先とアクティビティを発見しよう

日付: 2026/04/17

カテゴリ: Travel

ソース: Discover this year’s trending summer travel destinations and activities

Google Workspace

タイトル: Education PlusおよびTeaching & Learningアドオンのお客様向けにNotebookLMの機能を拡張

日付: 2026/04/14

カテゴリ:

ソース: Expanded NotebookLM capabilities for Education Plus and Teaching & Learning add-on customers

タイトル: GeminiのNEET UG模擬テストで試験対策

日付: 2026/04/14

カテゴリ:

ソース: Prepare for the NEET UG with practice tests in Gemini

タイトル: ChromeOSタッチコントローラールーム向けGoogle Meet認定BYOD周辺機器スイッチャーを追加

日付: 2026/04/14

カテゴリ:

ソース: Additional BYOD peripheral switchers certified for Google Meet in ChromeOS touch controller rooms

タイトル: Google ClassroomのGeminiがClassroom対応の全言語で利用可能に

日付: 2026/04/15

カテゴリ:

ソース: Gemini in Google Classroom is now available in all Classroom-supported languages

タイトル: Google VidsにGemini 3.1 Flash TTS搭載のより表現力豊かなAIナレーションと16の追加言語が登場

日付: 2026/04/16

カテゴリ:

ソース: New more expressive AI voiceovers in Google Vids, and 16 additional languages, powered by Gemini 3.1 Flash TTS

タイトル: Mac版Geminiアプリが利用可能に

日付: 2026/04/16

カテゴリ:

ソース: Now available: The Gemini app for Mac

タイトル: ベータ版公開:クライアントサイド暗号化されたGoogleスライドのダウンロード

日付: 2026/04/16

カテゴリ:

ソース: Now in beta: Download client-side encrypted Google Slides

タイトル: Google Meetの高解像度ディスプレイでの映像品質を改善

日付: 2026/04/18

カテゴリ:

ソース: Improved video quality on high-resolution displays in Google Meet

タイトル: Google Workspace管理コンソールにおけるGemini Enterpriseの管理者向け設定を簡素化

日付: 2026/04/18

カテゴリ:

ソース: Streamlining admin controls for Gemini Enterprise in the Google Workspace Admin console

タイトル: Google Workspace Updates 週間まとめ – 2026年4月17日

日付: 2026/04/18

カテゴリ:

ソース: Google Workspace Updates Weekly Recap – April 17, 2026

OpenAI

企業がCloudflare Agent CloudでOpenAIを活用したエージェントワークフローを構築

AI Agent 動作環境がまた一つ増えました。

強靭なスケーラビリティを期待できますね。

CloudflareがOpenAIのフロンティアモデル(GPT‑5.4など)をAgent Cloud全体に統合し、何百万もの企業が直接アクセスできるようになりました。これにより、顧客対応・システム更新・レポート生成などの実業務を自動処理するAIエージェントを、安全な本番環境でグローバルに展開できます。

Agent Cloudとは

Agent Cloudは、Cloudflare Workers AI上で動作するプラットフォームで、企業がAIアプリケーションやエージェントをエッジで高速・リアルタイムに構築・展開できる基盤です。OpenAIモデルとの統合により、インテリジェンスとエンドユーザーの距離を大幅に縮めることが可能になりました。

CodexとCloudflare Sandboxesの連携

OpenAIのCodexハーネスを活用したエージェントをCloudflareにデプロイできるようになりました。Cloudflare Sandboxesでは、開発者がAIアプリケーションを構築・実行・テストできる安全な仮想環境が一般提供開始されており、今後Workers AIでも利用可能になる予定です。

OpenAIの現状と規模

- 世界中で100��万以上のビジネス顧客が直接利用

- Codexは週間300万ユーザーが利用

- OpenAI APIは毎分150億トークン以上を処理

日付: 2026/04/13

カテゴリ: Global Affairs

ソース: Enterprises power agentic workflows in Cloudflare Agent Cloud with OpenAI

次世代サイバー防御のための信頼されたアクセス

本人確認が必要なAI が、ついに来ました!

早速運転免許証で、本人確認をしてみました。

・・・が、資格なしとなってしまいました。

OpenAIは「Trusted Access for Cyber(TAC)」プログラムを拡大し、数千人の認証済み個人防衛者と、重要ソフトウェアの防衛を担う数百チームへのアクセスを提供する。また、サイバー防衛に特化したモデル「GPT‑5.4‑Cyber」を新たに導入した。

3つの基本原則

- 民主化されたアクセス: KYCや本人確認などの客観的な基準を用いて、正当な利用者に広くアクセスを提供することを目指す。

- 段階的な展開: システムを慎重に世界へ展開しながら、能力とリスクの両面を継続的に改善していく。

- エコシステムの強靭化: 信頼アクセス経路、助成金、オープンソースセキュリティへの貢献、Codex Securityなどを通じて防衛コミュニティを支援する。

サイバーセキュリティ戦略の柱

- サイバーリスクはすでに存在しており、AIによって加速しているが、対策は可能。

- リスクはモデル単体ではなく、ユーザーや利用状況によっても決まる。

- モデルの能力向上に合わせて、防衛策も継続的にスケールさせる必要がある。

- Codex Securityは直近のリリース以降、3,000件以上の重大・高リスク脆弱性の修正に貢献している。

- ソフトウェア開発そのものをより安全にすることが、エコシステム全体の強化につながる。

GPT‑5.4‑Cyber の展開

GPT‑5.4‑Cyberは、正当なサイバーセキュリティ業務における拒否の閾値を下げ、バイナリリバースエンジニアリングなど高度な防衛ワークフローを可能にする。現在は審査済みのセキュリティベンダー・組織・研究者を対象に限定展開中。

- 個人ユーザー:chatgpt.com/cyber で本人確認が可能

- 企業:OpenAI担当者を通じてチームアクセスをリクエスト可能

日付: 2026/04/14

カテゴリ: Security

ソース: Trusted access for the next era of cyber defense

Agents SDKの次なる進化

OpenAIはAgents SDKを大幅にアップデートし、開発者がファイルの検査・コマンド実行・コード編集・長期タスクをセキュアなサンドボックス環境で実行できるエージェントを構築しやすくした。

モデルネイティブなハーネスの導入

従来のエージェントフレームワークには、モデル非依存の柔軟性・モデル提供元SDKの可視性・マネージドAPI��の利便性の間でトレードオフが存在していた。新しいAgents SDKは、OpenAIのフロンティアモデルの能力を最大限に引き出すよう設計されたモデルネイティブなハーネスを提供し、以下の機能を標準搭載している。

- 設定可能なメモリ

- サンドボックス対応のオーケストレーション

- Codex風のファイルシステムツール

- MCP経由のツール使用

- Skills・AGENTS.md・シェルツール・パッチ適用ツールなどの標準統合

ネイティブサンドボックス実行

エージェントが安全にファイルの読み書き・依存関係のインストール・コード実行を行えるサンドボックス環境をSDKが標準提供。対応サンドボックスプロバイダーとして、Blaxel・Cloudflare・Daytona・E2B・Modal・Runloop・Vercelをサポートしている。また、Manifest抽象化により、ローカルファイルのマウントやAWS S3・Google Cloud Storage・Azure Blob Storage・Cloudflare R2などのストレージ連携が可能。

ハーネスとコンピュートの分離

セキュリティ・耐久性・スケーラビリティを高めるため、ハーネスとコンピュート環境を分離する設計を採用。

- セキュリティ: モデル生成コードが実行される環境に認証情報が漏洩しにくい構造

- 耐久性: スナップショットとリハイドレーションにより、コンテナ障害時も実行を継続可能

- スケーラビリティ: 複数サンドボックスの並列実行やサブエージェントの分離環境へのルーティングが可能

日付: 2026/04/15

カテゴリ: Product

ソース: The next evolution of the Agents SDK

私たちすべてを守るサイバー防御エコシステムの加速

OpenAIの「Trusted Access for Cyber(TAC)」は、高度なサイバー防衛能力を広く防衛者に届けつつ、信頼・検証・安全策に応じてアクセスを段階的に拡大するという考え方に基づいている。オープンソースのセキュリティチームや脆弱性研究者から、複雑なデジタル環境を運営する大企業まで、幅広い組織が参加している。

日付: 2026/04/16

カテゴリ: Security

ソース: Accelerating the cyber defense ecosystem that protects us all

ライフサイエンス研究向けGPT-Rosalindを発表

日付: 2026/04/16

カテゴリ: Research

ソース: Introducing GPT-Rosalind for life sciences research

Codexで(ほぼ)すべてをこなす

コーディングを超えた操作性

- バックグラウンドでのコンピューター操作により、画面認識・クリック・入力など、あらゆるアプリを自律的に操作可能

- 複数のエージェントが並行して作業でき、他の作業を妨げない

- アプリ内ブラウザーが追加され、ページに直接コメ��ントして正確な指示が出せるように

- gpt-image-1.5 を使った画像生成・反復改善にも対応

90以上の新プラグイン

- スキル・アプリ連携・MCPサーバーを組み合わせ、多様なツールと連携

- 主な対応プラグイン:Atlassian Rovo(JIRA)、CircleCI、GitLab Issues、Microsoft Suite、Neon by Databricks など

開発ライフサイクル全体のサポート

- GitHubレビューコメントへの対応、複数ターミナルタブの実行

- SSH経由でのリモートdevboxへの接続(アルファ版)

- PDF・スプレッドシート・スライドなどをリッチプレビューで表示

- 新しいサマリーペインでエージェントの計画・情報源・成果物を追跡

作業の継続と自動化

- 既存の会話スレッドを再利用し、コンテキストを維持したまま作業を継続

- 数日〜数週間にわたる長期タスクにも対応

- Pull Requestの対応、Slack・Gmail・Notionでのやり取りの把握など自動化が可能

メモリ機能(プレビュー)

- 個人の好みや修正履歴、収集に時間がかかった情報を記憶

- 次に取り組むべきタスクを提案し、プロジェクトの再開ポイントも示せる

提供状況

- 本日よりChatGPTにサインインしているデスクトップ版ユーザーに順次展開

- コンピューター操作機能はまずmacOSで提供、EU・英国にも近日展開予定

- パーソナライズ機能はEnterprise・Edu��・EU・英国向けに近日公開予定

日付: 2026/04/16

カテゴリ: Product

ソース: Codex for (almost) everything

Anthropic

Anthropicの長期利益信託、ヴァス・ナラシンハンを取締役に任命

日付: Apr 14, 2026

カテゴリ: Announcements

ソース: Anthropic’s Long-Term Benefit Trust appoints Vas Narasimhan to Board of Directors

Claude Opus 4.7を発表

Claude Opus 4.7 が正式リリースされた。前モデルの Opus 4.6 と比較して、高度なソフトウェアエ�ンジニアリング能力が大幅に向上しており、特に難易度の高いタスクで顕著な改善が見られる。ユーザーはこれまで密な監視が必要だった複雑なコーディング作業を、自信を持って Opus 4.7 に任せられると報告している。

主な改善点

- 指示への忠実な対応:以前のモデルより指示を厳密に解釈・実行するようになった。既存のプロンプトが予期しない結果を生む場合があるため、再調整が推奨される。

- マルチモーダル強化:高解像度画像(最大2,576ピクセル、約375万画素)に対応。従来モデルの3倍以上の解像度で、スクリーンショット読み取りや複雑な図表からのデータ抽出が可能になった。

- 実務能力の向上:財務分析・プレゼン作成・法務など経済的価値の高い知識業務で高い評価を獲得。GDPval-AAでも最高水準のスコアを記録。

- メモリ機能の改善:ファイルシステムベースのメモリ活用が向上し、長期・複数セッションにわたる作業でも重要な情報を記憶・活用できる。

日付: Apr 16, 2026

カテゴリ: Product

ソース: Introducing Claude Opus 4.7

Claude CodeでClaude Opus 4.7を活用するベストプラクティス

日付: Apr 16, 2026

カテゴリ: Claude Code

ソース: Best practices for using Claude Opus 4.7 with Claude Code

Claude Codeの使い方:セッション管理と100万トークンコンテキスト

セッション管理の指南書です!

今までなんとなく、/clear /compact だけやってましたが、rewind も使っていきたいと思います。

「間違った場合には、後続セッションで修正を指示するのではなく、遡ってやり直させる」というのも、

経験則としてやっていましたが、明示されると気持ちがスッキリしますね。

コンテキスト・コンパクション・コンテキストロットの基礎

コンテキストウィンドウとは、モデルが次の応答を生成する際に「見える」すべての情報(システムプロンプト・会話履歴・ツール呼び出しとその出力・読み込んだファイルなど)を指す。Claude Codeは100万トークンのコンテキストウィンドウを持つ。コンテキストが増えるにつれてモデルの性能が低下する現象を「コンテキストロット」と呼ぶ。コンテキストの上限に近づくと、作業内容が自動的に要約され新しいウィンドウで継続される(これを「コンパクション」と呼�ぶ)。

ターンごとの分岐点:5つの選択肢

Claudeがタスクを完了した後、次に取れる行動は以下の5つ:

- Continue(続行) — 同じセッションで次のメッセージを送る

/rewind(Esc×2) — 以前のメッセージに戻り、そこからやり直す/clear— 新しいセッションを開始する- Compact — セッションをここまで要約し、その上で作業を続ける

- サブエージェント — 独立したクリーンなコンテキストを持つエージェントに次の作業を委任し、結果だけを受け取る

新しいセッションを開始するタイミング

基本的なルールは「新しいタスクを始めるときは新しいセッションも始める」こと。ただし、直前に実装した機能のドキュメントを書くなど、関連タスクで一部のコンテキストがまだ有効な場合は、セッションを継続した方が効率的なこともある。

修正よりもリワインドを活用する

Claudeが間違ったアプローチを取った場合、「それはうまくいかなかった、代わりにXを試して」と入力するより、/rewindでファイル読み込み直後に戻り、学んだことを踏まえて再プロンプトする方が効果的。また「ここから要約して」と指示することで、次のClaudeへの引き継ぎメッセージを作成させることもできる。

コンパクトvs新規セッション

/compact— モデルが会話を要約し、その要約で履歴を置き換える。手間が少ないが情報が失われる可能性がある。/compact focus on the auth refactorのように指示を加えて誘導することも可能。/clear— 自分で重要な情報を書き出して新規スタート。手間はかかるが、コンテキストの内容を自分でコントロールできる。

日付: Apr 15, 2026

カテゴリ: Claude Code

ソース: Using Claude Code: session management and 1M context

並列エージェント向けにClaude Codeデスクトップ版を再設計

Anthropicは、複数のClaude Codeタスクを同時に実行しやすくするため、Claude Codeデスクトップアプリの大規模なリデザインをリリースしました。複数セッションを管理する新しいサイドバー、ドラッグ&ドロップによるレイアウト、統合ターミナルとファイルエディタ、そしてパフォーマンス改善が含まれています。

日付: Apr 14, 2026

カテゴリ: Claude Code

ソース: Redesigning Claude Code on desktop for parallel agents

Claude Codeにルーティン機能を導入

ルーティンとは

Claude Codeに新機能「ルーティン」がリサーチプレビューとして登場。ルーティンとは、プロンプト・リポジトリ・コネクターを一度設定するだけで、スケジュール実行・APIコール・イベントトリガーによって自動的に動作するClaude Codeの自動��化機能。ラップトップを開いていなくてもクラウド上で動作する。

スケジュールルーティン

時間・夜間・週次などのサイクルを指定してClaudeに実行させる機能。例えば「毎晩2時にLinearからバグを取得し、修正を試みてドラフトPRを作成する」といった自動化が可能。CLIの /schedule コマンドも本機能に統合された。

APIルーティン

各ルーティンに専用エンドポイントとトークンが付与され、HTTPリクエストで起動できる。アラート通知・デプロイフック・社内ツールなど、あらゆるシステムと連携可能。例えば「アラートのペイロードを読み取り、担当サービスを特定して #oncall チャンネルにトリアージサマリーを投稿する」といった用途に対応。

Webhookルーティン(GitHub連携)

GitHubのリポジトリイベントをトリガーにルーティンを自動起動できる。PRごとに新しいセッションが作成され、コメントやCIの失敗などのフォローアップにも継続対応。今後はGitHub以外のイベントソースにも拡張予定。

主な活用例

- スケジュール系:バックログの夜間トリアージ・ラベル付け・Slack通知、ドキュメントの乖離検出と更新PR作成

- API系:デプロイ後の自動スモークテスト・エラーログ確認・リリース判定通知、Datadogアラートのトリアージと修正案の自動作成

- GitHub系:PythonSDKのPRをGoSDKへ自動移植、チーム独自のセキュリティ・パフォーマンスチェックリストによるコードレビュー

利用条件と制限

Pro・Max・Team・Enterpriseプランのユーザーが利用可能(Claude Code on the web が有効な場合)。1日あたりの実行上限はProが5回、Maxが15回、Team/Enterpriseが25回。上限を超える場合は追加使用料が必要。

日付: Apr 14, 2026

カテゴリ: Product announcements

ソース: Introducing routines in Claude Code

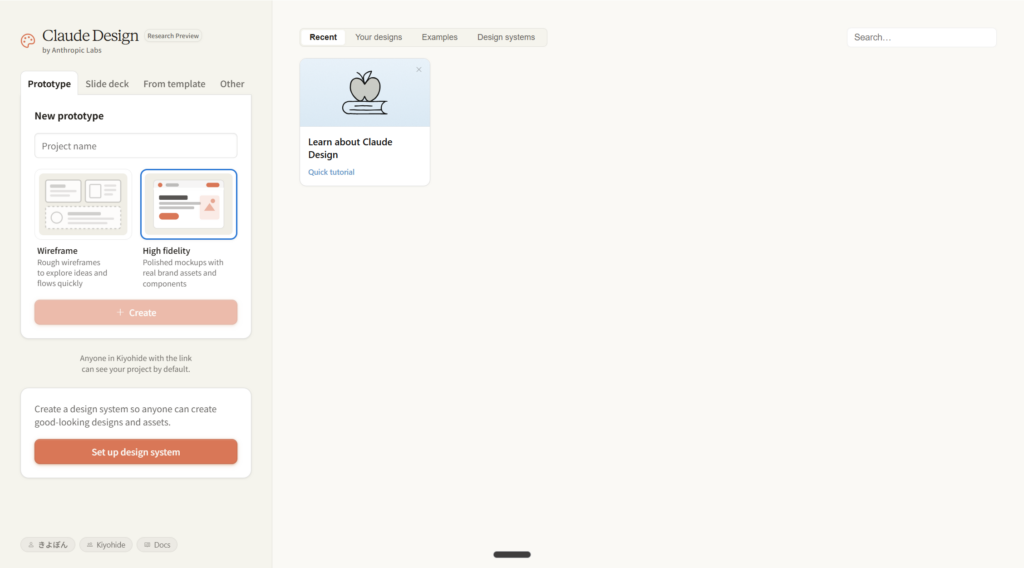

Anthropic Labsによる「Claude Design」を発表

Claude Designとは

2026年4月17日、AnthropicはAIと協力してデザイン・プロトタイプ・スライド・ワンページャーなどのビジュアル制作ができる新製品「Claude Design」をリリースした。最高性能のビジョンモデル「Claude Opus 4.7」を搭載しており、Pro・Max・Team・Enterpriseプランのユーザーを対象にリサーチプレビューとして提供されている。

主な活用シーン

- リアルなプロトタイプ: 静的モックアップをインタラクティブなプロトタイプに変換し、コードレビューなしでフィードバック収集が可能

- 製品ワイヤーフレーム: PMがフィーチャーフローを設計し、Claude Codeへ引き渡して実装

- デザイン探索: 多様な方向性を素早く試作・比較

- ピッチデッキ: 粗いアウトラインからブランドに沿ったデッキを数分で作成し、PPTXやCanvaへエクスポート

- マーケティング素材: ランディングページ・SNS素材・キャンペーンビジュアルの制作

- フロンティアデザイン: 音声・映像・3D・AIを組み込んだコード駆動プロトタイプの構築

主な機能

- ブランドシステムの自動適用: コードベ�ースやデザインファイルを読み込み、色・フォント・コンポーネントを自動反映

- 多様なインポート: テキスト・画像・DOCX/PPTX/XLSXファイル・コードベース・Webキャプチャに対応

- 細かい編集操作: インラインコメント・テキスト直接編集・スペース/カラー/レイアウトの調整ノブ

- コラボレーション: 組織内での共有・共同編集・グループチャットが可能

- エクスポート: URL共有・フォルダ保存・Canva/PDF/PPTX/HTMLへの書き出し

- Claude Codeへの引き渡し: デザイン完成後、ワンコマンドでClaude Codeに実装を依頼可能

日付: Apr 17, 2026

カテゴリ: Product

ソース: Introducing Claude Design by Anthropic Labs

Figma

MCPの要点まとめ:コンテキストが重要な理由とその活用方法

MCPとは何か

MCP(Model Context Protocol)は、AIツールがチームの既存ツールやデータソースからコンテキストを取得するための共通規格です。AIがFigmaのデザインを「スクリーンショット」としてではなく、コンポーネント・トークン・レイアウトの意思決定を含む構造化データとして読み取れ��るようになります。

デザイナーへの影響:ファイルの影響力が増す

デザインシステムはこれまで製品の一貫性を保つためのものでしたが、今やAIが生成するコードにも直接影響を与えます。ファイルの作り方がそのままコードに反映されるため、小さな不整合がAIによって大規模に複製されるリスクがあります。MCPはコードとキャンバスをつなぎ、開発者がコードで構築した内容をデザイナーがキャンバスに戻して確認・修正できるようにします。

開発者への影響:翻訳作業が減り、本質的な開発に集中できる

従来、デザインをコードに変換する作業には多くの手動解釈が必要でした。MCPにより、AIエージェントはコードベースの実際のコンポーネントを参照し、正しいトークンを適用した状態でコードを生成できます。また、コードからキャンバスへの逆方向の連携も可能になりました。

チーム全体への影響:往復するデザインワークフロー

開発者がエッジケースに直面した際、現在のUIをFigmaキャンバスに戻すことで、デザイナーが実際のコンポーネントを使って解決策を検討し、PMが両バージョンを比較できます。合意後、開発者はMCPのコンテキストを保ったまま更新デザインをコードに戻して実装できます。この往復ループを支えるのが generate_figma_design(HTMLをFigmaレイヤーに変換)と use_figma(エージェントがキャンバス上でデザインを作成・編集)の2つのツールです。

MCPを最大限に活用するためのポイント

- スキルでエー��ジェントを誘導する:どのコンポーネントを使うか、どの規約に従うかをMarkdownファイルで指定することで、出力の精度が向上します。

- デザインシステムに投資する:レイヤー名を明確にし、オートレイアウト・実コンポーネント・トークンを活用し、インタラクションの意図をアノテーションで補足することが重要です。

- 変数にコード構文を追加する:

brand-blueではなくcolor-brand-blue(CSS)のように実際のコード表記を設定することで、出力精度が大幅に向上します。 - Code ConnectでコードとFigmaをつなぐ:FigmaコンポーネントとコードコンポーネントのマッピングをAIに伝えることで、コードベースの検索が不要になります。

日付: 2026/04/16

カテゴリ:

ソース: The TL;DR on MCP: Why context matters and how to put it to work