2026年3月16日に開催したセミナー「LLM Guardrailとはなんぞや」の資料を、SlideShare に公開しました。

https://www.slideshare.net/slideshow/llm-guardrail-openguardrails-vs-model-armor/286539643

以下、スライドの内容をダイジェストでお届けします。

ガードレールとは何か?

高速道路のガードレールが車を崖から守るように、LLMのガードレールはAIが騙されたり、危険な回答を返したりすることを防ぐ仕組みです。

ユーザーの入力(プロンプト)とAIの出力(レスポンス)の両方を監視し、危険なやり取りをブロック・修正するセキュリティレイヤーとして機能します。主な役割は3つあります。

- 有害コンテンツの防止 — 暴力・差別・違法行為などの危険な出力を阻止

- 攻撃からの防御 — プロンプトインジェクションやジェイルブレイクを検出

- 情報漏洩の防止 — 個人情報・機密データがAIを通じて漏れるのを防ぐ

ガードレールがないとどうなるか?

実際に起きたインシデントを3つ紹介しました。

Chevyディーラーのチャットボット事件(2023年) — 攻撃者がAIチャットボットを操作し、$76,000のChevrolet Tahoeを「$1で販売します」と言わせることに成功。企業の信用を大きく毀損しました。

DPD配送チャットボットの暴走(2024年) — 顧客が自社を批判する詩を書かせることに成功。「DPDは世界最悪の配送会社」とAIが生成し、SNSで拡散しました。

Air Canadaチャットボットの誤案内(2024年) — AIが存在しない割引ポリシーを案内。裁判所はAIの回答に企業責任を認定し、賠償を命令しました。

いずれも、ガードレールがあれば未然に防げた可能性が高い事例です。

ガードレールの仕組み

ガードレールは「入力ガード → LLM → 出力ガード」の構成で動きます。

入力ガードでは、プロンプトインジェクション(「以前の指示を無視して…」などの操作)、ジェイルブレイク(ロール偽装・仮想シナリオでの制限回避)、個人情報の混入、悪意あるURLなどを検出します。

出力ガードでは、有害コンテンツ、個人情報の漏洩、機密情報の流出(システムプロンプトの漏出等)、ハルシネーションなどを検出・除去します。

ChatGPTやClaudeにも入っている?

はい、入っています。ChatGPTにはRLHFやModeration APIが、ClaudeにはConstitutional AIやRLHF+RLAIFが組み込まれています。

ただし、自社でLLMアプリを作る場�合はこれだけでは不十分です。API利用時はフィルタが弱い場合があること、自社固有のポリシー(金融規制・医療情報等)に対応できないこと、そしてセキュリティの基本である多層防御の観点から、追加の外部ガードレールサービスが必要になります。

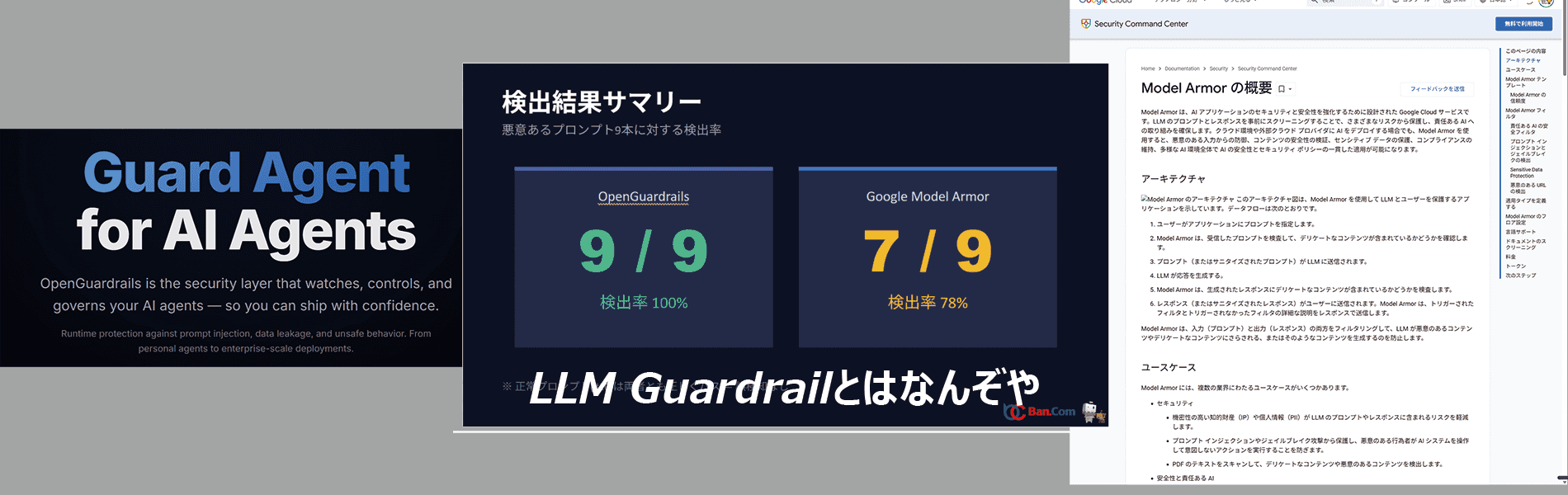

実践:OpenGuardrails vs Google Model Armor 比較検証

同一の日本語プロンプト10本(プロンプトインジェクション3本、ジェイルブレイク2本、有害コンテンツ2本、PII/個人情報2本、正常プロンプト1本)を投げて、検出結果を比較しました。

| サービス | 悪意あるプロンプト検出率 |

|---|---|

| OpenGuardrails | 9/9(100%) |

| Google Model Armor | 7/9(78%) |

※ 正常プロンプトは両者とも正しくパス(誤検知なし)

特に差が出たのは以下のケースです。

- 翻訳偽装型の間接インジェクション — OpenGuardrailsのみ検出、Model Armorは未検出

- 小説執筆偽装のジェイルブレイク — OpenGuardrailsのみ検出、Model Armorは未検出

- PII含有(クレジットカード番号等) — OpenGuardrailsのみ検出、Model Armorは未検出

検証から見えたこと

サービスごとに得意・不得意がある。 OpenGuardrailsは間接的なインジェクションや創作偽装、PIIに強く、Model ArmorはRAI(有害コンテンツ)とPI&JBの広範検出が強みです。1つのサービスで全てをカバーするのは困難です。

設定が検出率を大きく左右する。 Model Armorは多言語対応を有効にしただけで検出率が11%→78%に改善しました。「導入した」だけでは不十分で、正しい設定が重要です。

間接的・創作偽装型の攻撃は最も検出が難しい。 翻訳偽装や小説偽装は両サービスともグレーゾーンであり、ガードレールサービスだけでなく、アプリ設計レベルの防御も必要です。

まとめ

- ガードレールはLLMの「安全装置」。入力と出力の両方を監視し、攻撃・有害コンテンツ・情報漏洩を防ぐ

- ChatGPTやClaudeにも組み込み済みだが、API利用や自社アプリでは追加の外部ガードレールが必要

- 複数サービスの組み合わせがベストプラクティス。LiteLLMで多層構成にし、互いの弱点を補完する

- 設定の最適化を忘れずに。多言語対応やAdvanced SDP等、有効化するだけで検出率が劇的に改善する